AI打破脑机接口延迟壁垒:瘫痪者“开口”仅需一秒

独家抢先看

IT之家 4 月 11 日消息,加州大学伯克利分校与旧金山分校的研究团队在脑机接口(BCI)领域取得突破,成功开发出一种技术,帮助重度瘫痪患者恢复自然语音表达。该技术利用人工智能(AI)模型,将大脑信号实时转化为可听语音,解决传统语音神经假体延迟问题。

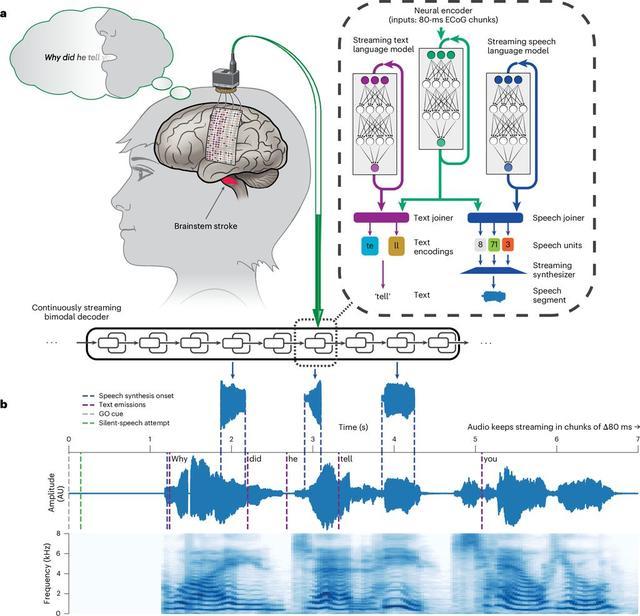

加州大学伯克利分校与旧金山分校的研究团队开发了一种创新方法,通过捕捉大脑运动皮层信号,利用 AI 算法实时解码并生成语音。

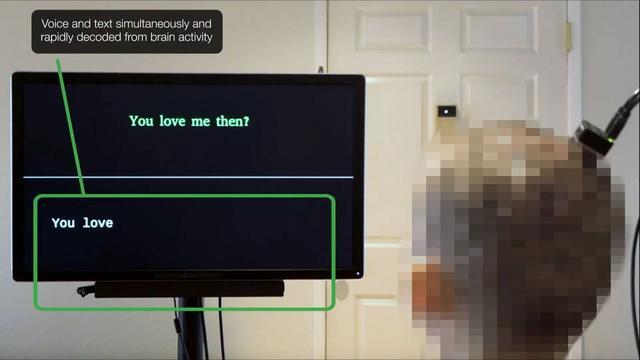

研究共同负责人、伯克利分校电气工程与计算机科学系助理教授 Gopala Anumanchipalli 表示,这种“直播”(streaming)方法借鉴了类似 Alexa 和 Siri 的语音解码技术,能显著缩短从大脑意图到语音输出的时间。实验中,患者 Ann 无需发声,仅通过“默想”句子即可生成接近自然的语音。

新技术的核心在于解决传统 BCI 语音解码的延迟问题。以往技术单句解码需约 8 秒,而新方法能在患者产生说话意图后 1 秒内输出首个音节。

研究共同第一作者、伯克利分校博士生 Kaylo Littlejohn 介绍,团队通过 AI 预训练文本转语音模型,模拟患者受伤前的声音,让输出更具个性化。实验还验证了该技术对多种脑信号采集设备(如微电极阵列和面部肌电传感器)的兼容性,显示其广泛适用性。

研究团队进一步测试了算法的泛化能力。他们让患者 Ann 尝试“说出”26 个未包含在训练数据中的单词,如 NATO 音标字母表中的“Alpha”、“Bravo”等。

结果显示,模型仍能准确解码,证明其不仅依赖模式匹配,而是真正学习了语音的构成规律。另一位共同第一作者、博士生 Cheol Jun Cho 表示,这种能力为未来提升语音表达的语气、音调等特征奠定了基础。

患者 Ann 反馈,相比 2023 年的早期实验,新方法让她感到更强的控制感和自我表达能力。研究团队计划继续优化算法,增强语音的自然度和情感表达,同时探索如何将技术应用于更广泛的临床场景。

“特别声明:以上作品内容(包括在内的视频、图片或音频)为凤凰网旗下自媒体平台“大风号”用户上传并发布,本平台仅提供信息存储空间服务。

Notice: The content above (including the videos, pictures and audios if any) is uploaded and posted by the user of Dafeng Hao, which is a social media platform and merely provides information storage space services.”