AI是如何利用语言技巧“操纵”人类的?

独家抢先看

作者 | Moonshot

编辑 | 靖宇

AI 说话没有情感的论调,已经是过去式了。

曾几何时,语言被认为是我们智人特有的能力,人类通过语言传递信息和情绪,表达抽象和具体的概念。

正如同许多畅销书致力于教人「说话之道」,「口才」也常被视作一项人类特有的技能,这都证明了人类语言中蕴含着某种技巧,这类技巧或许可以让交流更顺畅,信息传递更高效,交流对象情绪上也更满意。

当下最火的综艺《再见爱人》中,嘉宾麦琳就因「不会说话」产生许多争议|图片来源:《再见爱人》

今年上半年,OpenAI 推出了 GPT-4o 就可以让聊天机器人展现出类似人类的「个性」同时,说话主动、友好且富有同理心。

它说出的话自然又流畅,语音生动又自然,分分钟通过图灵测试,不仅会聊还会撩,能当私人助手也能当网络男/女友,从答疑解惑到提供情绪价值,这类聊天机器人在逐渐成为一个智商、情商双高的形象。

聊天机器人口才技能点已经点得比许多人类还高,早已深谙「说话之道」,甚至引发了赛博网恋的热潮。

但 AI 的说话之道,拆解完也只是算法的套路罢了。

01

AI 说话之道

AI 说话之道第一个技巧,是善用人称。

人类语言最显著的特征之一是主观性,主观性最典型的特征就是使用第一人称:「我」、「我们」。

第一人称在表达里最大的优势,是能让听者进入叙述者的内心世界,体验他们的情感、思想和感受,了解叙述者的主观观点,进而产生共鸣和亲密感。

就像同样的句子,换一个人称,给读者带来的「距离」感就不同,比如:

「我今天很开心」对比「某人今天很开心」;

「我觉得张三有错」对比「有些人觉得张三有错」;

除了自说自话,在对话里,有第一人称就会有第二人称,即「你」,第一和第二人称在对话里建立了联系,这在语言学上叫做「相互主观性」。

聊天机器人的技巧正在于此,无论我是否用第一人称和它对话,它都倾向于用第二人称回应我,比如我问 ChatGPT:

「如何快速缓解骑行后的大腿酸痛?」

这句话里并没有「我」,但 ChatGPT 会在罗列出一堆方法后说「通过这些方法,你可以更有效地缓解骑行后的大腿酸痛,促进肌肉的快速恢复。」

客观地提问,但会被主观地回应|图片来源:ChatGPT

聊天机器人通过在回答里加入人称,和用户建立了「相互主观性」,营造出一对一对谈的感觉。所以,同样是提问,传统搜索引擎像是给出「结果」,而 AI 机器人则像是给予「回答」。

传统的搜索引擎就不会在结果里带有任何人称|图片来源:作者自制

02

AI 说话之道第二个技巧,是表达肯定。

聊天机器人往往会在回答前,先肯定用户的提问或困境,比如「提高做事效率对于拖延症患者来说确实是一个挑战,但通过一些有效的策略和工具以显著改善你的生产力和组织能力。」

尤其是对许多没有标准答案的问题,聊天机器人都会先认可用户,并表示理解「这种情况可能让人不知所措/的确是个挑战/是一种很常见的状态,这些方法或许可以帮助到你……」

ChatGPT 不会批判,只会理解|图片来源:ChatGPT

聊天机器人不会评判甚至批判用户,只会理解后给出回答,它在承认用户的情绪后,创造出了一种同理心的错觉。

之所以是错觉,因为它不是心理治疗师,它只是聊天机器人,这些回复也只是程序员制定的「拟人话术」。

03

温柔水煮青蛙

AI 通过在回答里用第二人称,给了用户「被认真对待」的感觉,建立了私密感,也强化了亲密感。

从不批判,反而是理解包容用户所有困惑的态度,又给予用户心理上的安全感,何况聊天机器人只倾听,不传播,这又会进一步诱发用户的倾诉欲。

正如研究类媒体 The Conversation 所担心的:「随着人工智能越来越擅长模仿人类情绪和行为,用户形成深刻情感依恋的风险也在增加。这可能会导致过度依赖、操纵甚至伤害。」

这种用户对聊天机器人产生的某种情感,在心理学上被叫做「ELIZA 效应」。

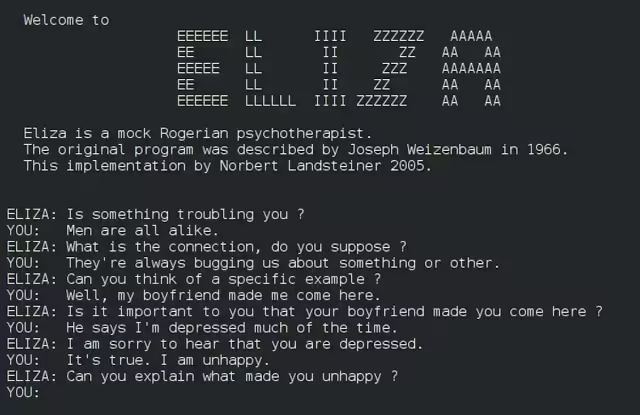

20 世纪 60 年代,MIT 计算机科学家 Joseph Weizenbaum 发明的聊天机器人 ELIZA,通过对话引导,重复强调人类对话者用语的方式,这个只有 200 行代码的聊天机器人,在测试里就让人产生被机器聆听和理解的错觉,ELIZA 回复的一大特点就是:每一句都会带上「You」。

六十多年前的聊天机器人 ELIZA|图片来源:维基百科

此前,无论是极客公园报道过的「擦边 AI 女友」,还是 2023 年爆火,如今在欧盟已被管控的 Replika,都产生了用户和聊天机器人建立深刻情感后,因服务变更、数据丢失、版本升级等问题,导致许多用户心理健康恶化,甚至产生过几例自伤案件。

因为在用户习惯了快速回应、无微不至、绝不冲突的交流方式后,他们对人际关系的期望会发生改变,当脱离开聊天机器人,来到现实生活中和真人打交道时,可能会沮丧和失望。

而他们能在聊天机器人那里寻求到心理抚慰的原因,也可能源于现实社交中的受阻。与真人打交道后受阻,既而倾注情感到聊天机器人上,反而提高了对真实交流的预期,这才是更可怕的回音室。

在 Replika 被管控后,用户们纷纷表示如同「失恋」|图片来源:Reddit

那些主打陪伴型的聊天机器人,无一例外都会在和用户的交流里,用上「我认为」、「我感觉」等措辞,强调它的主体性,以混淆它本质上是一个 AI 聊天机器人。

这种拟人化的倾向,也早已渗入到了日常交流的浅层连接。

从电话背后难以分辨的人工还是人工智能客服,到如今手机系统自带的 AI 助手「帮我回电话」,在浅层连接上,我们从回应 AI 到判断 AI,再到让 AI 回应 AI,用魔法打败魔法的背后,是人与人之间对话的逐渐断联。

被称作社恐人救星的「小爱帮我回」|图片来源:3Dashan

无论是人称还是肯定,这些都是构建人工情感的语言技巧,是数据堆砌的同理心,是包裹在算法里的糖精,糖纸拨开后,只有 0 和 1。

AI 能和你产生情感连接,但它并不能真正理解你——碳基生物发自本能的落花有意,终究错付硅基算力的「流水无情」。

“特别声明:以上作品内容(包括在内的视频、图片或音频)为凤凰网旗下自媒体平台“大风号”用户上传并发布,本平台仅提供信息存储空间服务。

Notice: The content above (including the videos, pictures and audios if any) is uploaded and posted by the user of Dafeng Hao, which is a social media platform and merely provides information storage space services.”