Agent爆火前夜,华为存储连发两道“硬菜”:让智能体有粮可吃、有忆可循

独家抢先看

作者 | 李水青

编辑 | 漠影

当下,OpenClaw——圈里人都叫它“龙虾”,正引爆一场AI Agent需求狂潮。

不是小火慢炖,是沸水滚开。企业级AI应用正从“聊两句就走”的对话机器人,向“接了任务就能干”的自主执行智能体,加速跃迁。

但当热度从技术圈蔓延到产业侧,问题也随之暴露:企业并没有想象中那么容易把Agent用起来。

一方面,中心侧推理效率成为瓶颈,大模型响应慢、多轮对话越用越卡,直接影响用户体验;另一方面,边缘部署则几乎更是重灾区:部署周期长、成本高、运维复杂,让大量企业望而却步。

与此同时,全球存储陷入“超级周期”涨价期,成本上涨,让本就紧张的AI预算雪上加霜。受AI算力扩张带来的数据洪流驱动,企业数据基础设施投入水涨船高。模型越做越大,上下文越拉越长,数据模态越来越杂,智能体不仅要“吃得饱”,还得“吃得有营养”。对大多数企业而言,预算吃紧,但AI的胃口却更难满足了。

3月17日,华为出手了。

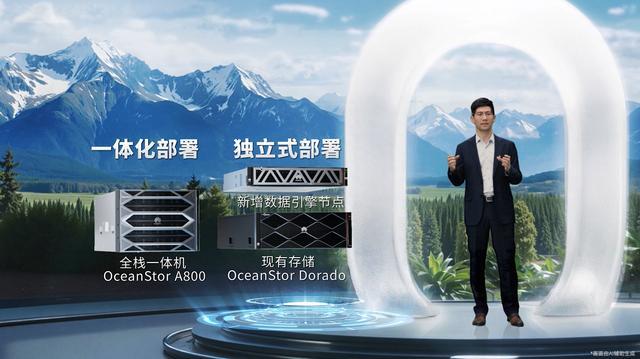

在2026年数据存储新春发布会上,华为抛出了一个直击要害的答案:推出面向中心推理场景的AI数据平台,以及面向分支边缘场景的FusionCube A1000 AI超融合一体机,试图以“数据基建”的重塑,击碎AI落地受阻的被动现状。

华为存储AI数据基础设施产品矩阵

一、从存数据到养龙虾:华为用两款新品回应推理时代降临

如果说过去的大模型时代,企业的核心任务是“训练出一个好模型”,那么进入Agent时代,命题已彻底变了:不是能不能训出来、而是能不能用起来——稳定、精准、低成本地落地见效。

但现实很骨感。大多企业在Agent落地过程中,不约而同撞上三堵墙:

第一,“吃不饱”。企业坐拥海量私域数据,但这些无法被有效转化为模型可用的“有效知识”,导致AI“有料但缺养分”;

第二,“记不住”。缺乏记忆能力,无法记住任务中间状态、无法积累历史经验,一旦遇到真实场景的复杂需求,便束手无策;

第三,“养不起”。尤其在分支边缘场景,部署繁琐、成本高昂、运维困难,AI看着好,就是难铺开。

这次,华为并没有空谈概念,也不是拿单点方案修修补补,而是给出一套系统性的解法——在中心和边缘两端发力,同时重构AI的数据底座。

1、中心侧:让数据变成“AI可直接消费的粮食”

华为数据存储产品线副总裁谢黎明在发布会上直言:“企业现在很容易获得GPU算力,也能获取比较先进的模型,但一旦开始用自身的数据,问题就接踵而来。”他把这些问题归结为三类:知识过时、长序列推不动和缺少长期记忆。

华为存储产品线副总裁、闪存领域总裁谢黎明

为此,华为推出了一套全新的AI数据平台,即承载了知识库、KV Cache加速、记忆库三大能力,三者能被华为UCM(Unified Cache Manager)统一调度、协同工作,像一个人的眼、手、脑,各司其职,又浑然一体。

谢黎明在讲解AI数据平台

知识库解决的是“吃什么”的问题。通过多模态解析、Token级表征与融合检索,企业数据从“原料”转化为“营养”。知识检索精度可达95%以上,从而解决“找不到、找不准”的问题。

KV Cache加速解决的是“吃得快”的问题。过去的AI,问一句等半天,转圈圈是常态。华为通过HBM、DRAM、SSD三层缓存架构,构建超大规模KV Cache池,数据在不同层级间按需流动,用查询的方式,避免重复计算。首Token时延降低90%,推理吞吐提升2倍。

记忆库解决的是“如何越吃越聪明”的问题。其支持工作记忆与长期记忆,既能记住当前任务上下文,也能沉淀每次交互的经验,使Agent从“金鱼”进化为“大象”,推理准确率提升30%。

华为AI数据平台核心设备

2、边缘侧:让中小企业也能“拎包养虾”

如果说中心场景拼的是算力密度、数据效率,那么在分支边缘场景,就拼的是落地性价比。建设成本高、业务周期长、调优门槛高,每个都扎在真金白银上。

华为FusionCube A1000 AI超融合的答案,只有四个字:开箱即用。

它融合通算智算一体化交付,还将AI平台、容器调度平台以及智能体预集成在一体机中,传统方案从设备安装到业务上线需要18周(4个月),而FusionCube A1000将这个周期缩短到2周。

真正的杀招,还不止于此。

华为FusionCube A1000 AI超融合

它不是那种“装完就废”的一次性盒子,而是一个能与中心协同进化的智能节点。边缘侧产生的数据可以回传至中心,在中心完成模型增训后,知识库与记忆库完成更新沉淀,再将进化后的模型一键下发至边缘侧,形成一个持续滚动的数据飞轮。

华为FusionCube A1000 AI超融合支持智能体持续学习

华为存储产品线副总裁张伟力在发布会上用了一个生动的比喻:“我们给AI装上了海马体——知识库让推理越来越精确,记忆库让决策越来越准确,数据飞轮启动后,AI才能持续进化。

华为存储产品线副总裁、虚拟化领域总裁张伟力

二、数据即战略,华为持续为AI Agent“建粮仓、备粮草”

两款新品的背后,藏着华为存储对AI时代的明确判断:AI的下半场拼的不是算力,是数据。

算力可以花钱买,模型可以开源拿,但高质量的数据、可消费的知识、可沉淀的记忆,这些决定AI能否真正跑通商业闭环的东西,买不来,也抄不走。

回顾过去一年华为存储的动作,可以清晰地看到一条“为AI铺路”的战略主线:

第一阶段主攻性能突围:剑指AI集群训推的性能天花板。 2025年,华为发布OceanStor A800高性能AI存储,单设备提供1000万IOPS、500GB/s超高带宽,支持NPU/GPU Direct Storage技术。什么意思?就是让存储不再成为GPU性能等待的拖油瓶。

第二阶段聚焦数据治理:聚焦多模态数据治理难题。华为推出AI数据湖,以OceanStor Pacific分布式存储为底座,叠加DME统一数据空间能力,实现跨域跨集群数据的全局可视、可管、可流动,将散落一地的数据收拢成湖。在中国崖州湾国家实验室,华为将跨地域的多组学数据、文献数据、农业采集数据汇聚联通,为农业分析模型与智能体开发提供数据语料基础。

第三阶段加码行业落地:瞄准AI行业化落地的数据工程难题。华为发布DCS AI解决方案,核心基于ModelEngine工具链,内置数据工程、模型工程与应用开发能力,大幅缩短AI开发周期。在与上海瑞金医院的合作中,双方仅耗时3个月研读103万张病理切片,推出RuiPath病理诊断模型,常见病理知识回答准确率超90%,在14个辅助诊断任务测试中全部领先,其中7个达到国际SOTA水准。阅片时间从20分钟缩短至10秒。

这三个阶段走下来,华为完成的是从“存得下”到“管得好”再到“用得上”的能力跃迁。当来到AI推理的“最后一公里”,于是,有了第四阶段。

第四阶段聚焦AI落地闭环:于中心侧,AI数据平台让推理体验跑入一个新时代;于边缘侧,FusionCube A1000让专业人才紧缺的中小企业也能“拎包入住”。

这四个阶段,本质上完成了一轮底层能力的跃迁。换句话说,这不是东一榔头西一棒槌,而是一步一步把路修到AI脚下,华为正在把“存储”,重新定义为AI时代的“操作系统语言”。

结语:谁掌握数据底座,谁掌握AI主动权

“AI的下半场是推理。”这已是行业共识。有研究预测,到2026年,全球训练与推理的资金投入占比将从过去的8:2变为2:8。中国市场的数据则更具冲击力:2026年2月,国内头部模型在单周内的Token调用量一度突破5万亿,创下新高。

那么,“AI下半场拼的是数据”,这句话在今天听来已不再是口号,而是每一家试图用AI重塑业务的企业必须直面的现实。当算力逐渐商品化、模型逐渐开源化,真正构成竞争壁垒的,是企业能否将数据资产成功转化为AI可消费的知识与记忆。

华为的野心,是做AI时代的“数据底座”。无论是中心的超级智算中心,还是边缘的零售门店、工厂车间、医疗机构,AI终将无处不在。而华为正在用一套覆盖数据全生命周期的产品矩阵,顺应这个时代的洪流。

数据永远是一切智能的源头。

这一次发布的AI数据平台和FusionCube A1000,试图让每一个智能体有粮可吃、有忆可循。可以预测,在数据成为核心战略资源的未来,谁掌握数据底座,谁就将掌握智能的主动权。

“特别声明:以上作品内容(包括在内的视频、图片或音频)为凤凰网旗下自媒体平台“大风号”用户上传并发布,本平台仅提供信息存储空间服务。

Notice: The content above (including the videos, pictures and audios if any) is uploaded and posted by the user of Dafeng Hao, which is a social media platform and merely provides information storage space services.”