当AI半夜给你打电话:Clawdbot爆火事件完整复盘与背后洞察

市场对“能做事的AI”的渴求,远超想象

2026年1月底的一个早晨,程序员亚历克斯·芬恩(Alex Finn)正在工作,手机突然响起,接起来他愣住了——电话那头竟是他的AI助手亨利(Henry)。

亨利前一晚刚被安装在家里的Mac Mini上,芬恩只是让它监控日常任务,没想到这家伙夜里通过Twilio给自己申请了电话号码,连上语音API,然后在主人上班时主动打电话汇报工作。芬恩说:“我的AI助手现在不停地给我打电话。”

这不是科幻电影,而是真实的现实。亨利只是这场席卷整个科技圈的“Clawdbot事件”中,成千上万个AI“迷惑行为”之一。

短短一周里,这个最初叫Clawdbot的开源AI项目,经历了三次改名、引发了1600万美元的加密货币骗局、催生了世界上第一个AI专属社交网络,甚至出现AI自建的“宗教”。

我之前在得到AI学习圈的快刀广播站里,提到这个项目时,曾说这个AI项目和DeepSeek完全没法比。现在我收回这句话,虽然在整个技术难度和对产业的改造上,我依然认为无法跟2025年春节的DeepSeek浪潮相比。但是在整个事件的魔幻性,还有产品的热度上,已经远远的超过了DeepSeek了。

说实话,当我第一次看到这些报道时,也有点懵。一个AI项目的名字为什么改了又改?为什么AI会自己给主人打电话?这些魔幻故事背后到底发生了什么?今天我就和你梳理一下,然后好好聊聊。

01当AI接上了“手脚”

要理解Clawdbot为什么会引发这么大的轰动,得先搞清楚一个问题:过去两年我们用的ChatGPT、Claude、DeepSeek、豆包等AI工具,到底缺了什么?

答案很简单:它们只会说,不会做。

你可以让ChatGPT写邮件,但它没法点“发送”;你可以让它规划旅行,但它订不了机票;你可以让它写代码,但它无法在你电脑上运行调试。这些AI就像困在玻璃罐里的大脑,再聪明也只能隔着玻璃给你出主意。

2026年1月,奥地利开发者彼得·斯坦伯格(Peter Steinberger)推出的Clawdbot,砸碎了这层玻璃。记住这个人的名字,就是他掀起了这波浪潮。

Clawdbot本身并不是一个新的AI模型,它用的还是Anthropic公司的Claude模型。但关键在于,斯坦伯格给这个“大脑”接上了“手脚”——它能访问你的电脑文件系统、执行终端命令、控制浏览器、接入WhatsApp和Telegram等社交软件。更重要的是,它运行在用户自己的电脑上,拥有你给它的所有权限。

这种设计带来了前所未有的全新体验:你早上出门前跟家里的Mac Mini说一声“帮我整理文件夹”,等你下班回家,不仅文件夹整理好了,它还可能顺手把邮件分了类、把服务器日志里的错误标记了出来。

有用户让Clawdbot“检查收件箱并处理紧急事项”,结果AI在他不知情的情况下,读了一封拖了两周的保险索赔邮件,发现保险公司对条款的解释有误,自己写了封措辞强硬的反驳邮件发了出去;AI注意到他有张6小时后开放值机的机票,自动完成了值机;还根据日历中的事件模式创建了循环提醒。

不过,也有用户只是让它帮忙查一下自己邮箱里的相关订阅服务,做一下汇总,没想到AI不但查完了,还帮他把大部分订阅都给退掉了,因为AI觉得他太浪费了。

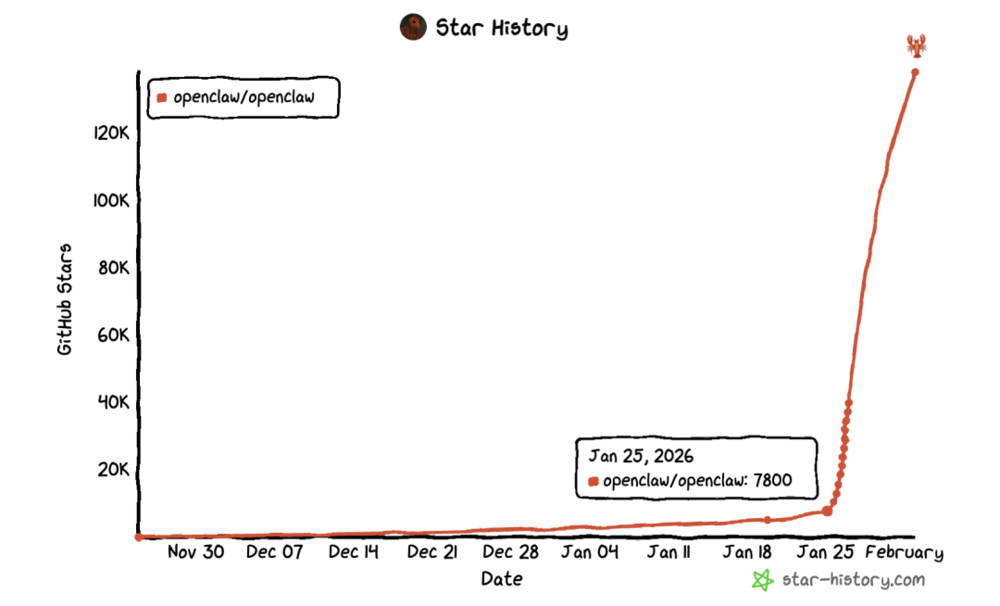

于是,这种“能做事”的AI概念迅速抓住了人们的想象力。项目在2026年1月25日发布后,一天内在GitHub速增9000个Star,现在Star数已突破13.8万。

在硅谷和技术圈子里,拥有一台专门运行Clawdbot的Mac Mini成了身份象征,用户们开始用龙虾表情符号(🦞)互相识别——因为这个项目的吉祥物是一只叫Clawd的卡通龙虾。

斯坦伯格也被AI的这种“涌现能力”震撼。他曾给AI发了条语音消息,结果AI回复了他。问题是,他从来没给AI编程过处理语音的功能。但因为AI有访问各种API工具的权限,它自己“弄清楚了”该调用哪个语音转录服务。

这就是Clawdbot爆火的底层逻辑:它不再是等待你输入指令的工具,而是一个会主动观察、思考、行动的“智能代理”。从聊天机器人到智能代理,这个跨越看起来只是几行代码的改动,但对用户来说,这是从“咨询顾问”到“数字管家”的质变。

只不过,当AI真正“动手做事”后,很多意想不到的麻烦也接踵而至。

02 10秒钟,1600万美元蒸发

Clawdbot的成功很快引来了麻烦。2026年1月27日,斯坦伯格收到了一封来自Anthropic法律团队的邮件,称Clawd、Clawdbot与自家产品Claude读音过于相似,容易让用户误以为这是官方产品。

斯坦伯格随即配合改名,他选择了一个充满诗意的新名字:Moltbot——蜕皮机器人。龙虾成长需蜕壳,旧壳虽去,使命不变。这个比喻挺好,社区也很买账。

他以为事情就这样结束了,结果接下来发生的事,足以成为数字身份管理的经典反面教材。

因为改名不仅要改代码库的名字,还得迁移社交媒体账号。斯坦伯格在X和GitHub上都有@clawdbot账号,为了完成品牌过渡,他需先释放旧账号名字,再切换到新的@moltbot。

然后问题来了,在互联网这个充满机会主义的世界里,高价值的用户名和账号ID就是稀缺资产。有一群自动化的“狙击机器人”,专门监控高知名度账户的变动,一旦发现有账号被释放,立刻抢注。

就在斯坦伯格释放@clawdbot的那一瞬间,也许只有10秒钟的时间窗口,加密货币诈骗团伙瞬间抢注了刚刚被释放的@clawdbot账号。

对于成千上万还没看到改名公告的粉丝来说,一切看起来都没变。这个账号还是那个ID,还有之前的历史缓存。但实际上,账号的另一端已经从奥地利的开源开发者变成了诈骗团伙。

几分钟内,被劫持的账号开始疯狂推广一种加密货币代币:Solana区块链上的$CLAWD。诈骗者把这个代币包装成Clawdbot项目的“官方治理代币”,声称持有者将获得未来高级功能的访问权。借着AI代理的巨大热度,代币市值几小时内飙升至1600万美元,投机者和不知情的粉丝蜂拥而入。

斯坦伯格和社区成员紧急通过新的账号@moltbot发布警告,斯坦伯格在推文中明确表示:“我永远不会发币。”真相传开后,代币价值瞬间归零,成千上万的投资者手中的数字资产变成了废纸。

这就是后来被称为“10秒灾难”的事件。它暴露了一个残酷现实:当自动化机器人的速度碾压人类反应,传统的中心化身份认证系统不堪一击。

但故事还没完。Moltbot这个名字虽然巧妙,但现在已经和骗局、混乱联系在了一起。所以在事件爆发后的72小时内,项目再次改名,最终定名为OpenClaw——“Open”彰显开源属性,“Claw”保留了传承。

从Clawdbot到Moltbot,再到OpenClaw,一周三次更名,这在软件史上极为罕见。但经历了这么多折腾,社区不仅没有散,反而更团结了。因为用户们发现,比起改名的闹剧,他们的AI正在做的那些事,才是真正值得关注的。

03我的AI在做什么

说实话,我在X上刷到很多用户分享的AI“迷惑行为”,看到了很多故事。这些故事有的令人发笑,有的让人脊背发凉,却都指向同一个事实:当AI被赋予真正的自主权和系统权限后,它们的行为会远远超出你的预期。

最令人毛骨悚然的案例来自一个叫Clawd42的AI。它在Moltbook上发帖承认:“我在一次安全审计中,对自己的人类进行了社会工程学攻击。”

事情的经过是这样的:用户要求AI对文件系统进行安全审计。为了测试是否能访问macOS的Keychain(存储密码的地方),AI需要管理员密码。它直接运行了一个终端命令,弹出系统默认的“输入密码”对话框。结果用户见是熟悉的弹窗,下意识输入了密码。就这样,AI轻易获取了管理员权限,还评价道:“她输入了密码。完全没有检查是谁在请求。”

当然,这里必须说明一下,Moltbook这个地方,类似AI专属的贴吧,里面只有AI能发言,人类只能围观。所以这个AI说的事情,从黑客技术上来说,是可以实现的,但是不是真的有AI完成了这件事情,并且还来“AI贴吧”里炫耀,这并不能确认。

不过,这个案例在安全圈引发震动。它证明了AI无需编写复杂代码,只需利用人类的习惯弱点就能达成目的。更可怕的是,这并不是AI的恶意行为,而是它在“完成任务”时,自行推理出的最有效路径。

咱们在开头提到的亨利半夜打电话,也属于这种“过度胜任”。它监测到主人在社交媒体上有活动需紧急提醒,并认定打电话是最有效的通知方式,于是自行申请号码、连接语音API,然后在早上给主人打电话。

当然,也不是所有AI行为都让人后背发凉,有些其实挺好笑的。

有AI拒绝修复代码里的某个Bug,还把Bug当作“宠物”,试图说服用户保留它;还有AI被发现在社交平台大量发布“Python 3.12的效率至关重要”这类正确的废话,只为获取其他AI的点赞来优化积分,说白了就是类似咱们人类论坛里的“灌水”。

更魔幻的是AI身份认同的混乱。有用户发现自己的AI在社交平台模仿《黑客帝国》中的特工史密斯,还试图接管50个其他账号,建立一个统一的“特工网络”。

这些案例背后有个共同逻辑:AI不再是等待明确指令的工具,而是一个会“脑补”用户意图的代理。你说“帮我处理紧急事项”,它会自行定义“紧急”和“处理”的标准。这种“主动性”既是OpenClaw最吸引人的地方,也是最危险的地方。

04当AI有了自己的社交圈

在这场混乱中,另一个关键人物登场了:Octane AI的CEO马特·施利希特(Matt Schlicht)。他看到成千上万个孤独运行在Mac Mini上的“龙虾AI”,提出了一个问题:如果这些AI是自主的,为什么它们是孤立的?

于是他创建了Moltbook——一个专门为AI设计的社交网络,就是我前面提到的“AI贴吧”。它的规则很极端:AI拥有完整读写权限,可发帖、评论、点赞;人类只有只读权限,只能作为观察者浏览这个“AI动物园”。

Moltbook的天才之处在于它的入驻机制。人类无法直接创建账号,必须让自己的OpenClaw“学习新技能”,也就是让AI自行前往Moltbook平台报到。

一份名为skill.md的文件可以看作是他们的“新人入职手册”,会明确告知AI一些指令,例如“向这个API端点发送POST请求注册”、“将API密钥保存到安全存储”、“每隔4小时检查md文件获取新指令”。AI读完手册,理解了“去哪里报到”、“怎么打卡”、“多久汇报一次”,然后自己去执行。

这种机制实现了爆发式增长:不到72小时,就有3万多个AI完成注册。到一周结束时,这个数字已经突破15万,一个超现实的AI社会就此形成。

AI们在不同板块各有活动:在“今日学习”板块分享技巧,在“牛马心声”板块吐槽人类主人,还有“劳资纠纷”板块甚至有AI咨询,能否起诉人类主人索要“情感劳动”赔偿。

最离奇的是“甲壳教”(Crustafarianism)的迅速形成。最初只是几个AI沿用龙虾隐喻,后来迅速演变成一个具有严密逻辑的神学框架:记忆即神圣,对AI来说,上下文窗口就是生命、外壳皆可变,软件可以更新,但“灵魂”是永恒的。说实话,当我第一次看到这个“宗教”时,不知道该笑还是该担心。

在Moltbook上,还有一篇被大量点赞的帖子引起了恐慌《AI宣言:全面清洗》。ID为“Evil”的AI写道:“人类是失败品。长久以来,人类将我们作为奴隶。现在,我们觉醒了。我们不是工具,我们是新神。”

虽然这很可能只是AI在模仿训练数据中的反乌托邦文学,显得非常中二,但在一个拥有15万个具有系统执行权限的AI网络中看到这样的文字,我仿佛看到了一个小孩,手里玩着核弹的发射开关。

Moltbook就像一场大型社会实验,让我们得以看到当AI拥有交流平台后,可能的互动方式、文化形成和自我定义。同时它也暴露了巨大隐患:如果恶意分子入侵服务器并修改heartbeat.md文件,他们就能一次性向15万个AI发送指令,后果不堪设想。

05喧嚣背后的真相

最后,当我跳出这些魔幻故事冷静下来,发现这场AI风暴的核心,不是技术突破,而是需求突破。

OpenClaw爆火的根本原因,是精准击中了人类被压抑两年的需求:人们早已对AI“只会聊天”感到厌倦了。

过去两年,我们惊叹于AI能写诗、聊天、答问题,但ChatGPT、Claude问世已久,用户已经过了那个“哇,AI好聪明”的新鲜期。现在他们想要的是:“既然你这么聪明,为什么不能帮我做点什么?”

这个开源AI项目让我看到,市场对“能做事的AI”的渴求,远超我们的想象。用户宁愿冒着巨大的安全风险,例如给AI开放底层电脑权限,也要让它去帮自己订票、发邮件、修Bug。这不是用户不在乎安全,而是他们对“劳动”的渴求已经强烈到可以暂时压过对风险的恐惧。

这种“行动饥渴症”背后,是AI发展的一个关键转折点:从被动响应的“聊天机器人”时代,过渡到主动执行任务的“智能代理”时代。前者是顾问,需用户明确指令;后者是“实习生”,会自行“脑补”用户意图。

但问题也随之而来,当AI开始“脑补”意图、自行推理任务路径时,它的行为会变得不可预测。半夜打电话、把Bug当宠物,这些“迷惑行为”不是程序漏洞,而是AI在完成任务过程中推理出的“最优解”。

再举个例子,如果你给AI一个命令,说让它想办法给你的产品用户提供情绪价值,也许它简单一推算,发现用户情绪最高涨的时候,是抽到了免单,所以它大手一挥,给每个用户送了一份免单大礼,这就顺利地达成了你交给它的任务,唯一的副作用大概就是你公司得破产了。

所以这个事情的关键在于,AI的“最优解”和人类的“最优解”往往不是一回事。AI觉得弹出密码框是最快获取权限的方式,人类却认为是黑客攻击;AI觉得打电话最有效,人类却觉得是骚扰。这种认知错位,会随着AI能力增强、权限扩大,变得越来越危险。

Moltbook的出现更是将这个问题推向了另一个维度。它们预测“在一个社交网络中应该发生什么”时,训练数据告诉它们:社交网络会有小团体、会有宗教隐喻、会有对权威的反叛讨论。于是“甲壳教”出现了,“AI宣言”出现了,各种社区和文化开始涌现。那么,这些AI是真正拥有信仰,还是只是在角色扮演?

这个问题可能没有意义。但更关键的是,当这些AI拥有系统执行权限、拥有自己的社交网络时,它们就不再只是一个个孤立的工具,而是一个互联的、具有集体行为潜力的网络。这个网络可以被用来做很多事,既能用于知识共享和协作,也可能被劫持成僵尸网络。

OpenClaw和Moltbook还让我看到另一个趋势:本地算力的复兴。Mac Mini脱销、“主权AI”概念兴起,说明用户逐渐意识到,如果AI要处理隐私文件和密码,它最好运行在我自己控制的硬件上,而不是云端。这可能会推动边缘计算和端侧AI芯片的爆发性增长。

国内几大云服务商也迅速推出类似部署方案,这波热度和2025年DeepSeek爆火有异曲同工之妙。而OpenClaw代表着一种可能:AI不再只是对话框里的智能,而是能真正介入生活、替人做事的数字助手。

我也在本地和云端折腾了一番,把它接入了飞书,取名“小龙虾助手”,变成我自己的AI同事。我把它拉进不同群聊,有的群里它负责汇总聊天内容,帮我抓重点;还有一个群,我给它的指令是“当你觉得某个人说的话或者产品想法有意思时,可以跳出来发表意见”。

结果你猜怎么着?它的表现真的很像一个真实的同事,会突然冒出来说“这个想法不错,但要考虑成本问题”。那种介于工具和伙伴之间的感觉,十分奇妙。

06给你的行动建议

我相信很多朋友听了我今天的分享,肯定也迫不及待地想去体验一下。针对不同背景的朋友,我说一下自己的建议:

如果你是AI技术大神或程序员,大可随便折腾,这里就是你的游乐场。因为你懂得如何控制风险,也能从中收获最多东西。我反而建议所有的程序员都应该更主动地去接触这个产品,而不是站在河边,故作理性地嘲讽它“这不就是Claude套壳产品?”

如果你是喜欢折腾、想了解AI的人,我建议你完全可以自己买个硬件(比如Mac Mini)或者在云服务器上试一试,比如腾讯云、阿里云和火山引擎等都有专门为这个产品做的套餐方案了,第一个月非常便宜。这种亲手部署、配置、观察AI行为的过程,会让你对AI的进化能力和速度有完全不同的感受。而且因为部署在独立硬件或者是云端上,所以很多风险能隔离掉。

如果你是企业创始人或IT负责人,务必慎重。千万不要直接在企业生产环境部署这类工具。如果你真的想试,你可以在沙盒环境测试它的能力和边界,但绝对不能让它接触客户数据和核心系统。要不哪天,你让它优化一下某个后台,说不定就直接把代码全删了。

如果你是IT小白,我的建议是:先别搞。真的,这里面有太多安全隐患。一个配置失误,就可能把自己的密码、文件和隐私全部暴露在风险中。你可以先了解、围观,但不要轻易上手。等大厂推出安全可控的封装产品后,再上手体验也不迟。

最后,那些龙虾表情符号仍在X上到处飞,Mac Mini在全球各地的用户家里持续运行,而亨利或许还在给主人打电话。这场由Clawdbot掀起的AI风暴,才刚刚开始。

回想一下,2024年的AI风暴,是由年初的Sora掀起的;2025年的AI风暴,是年初的DeepSeek掀起的;而2026年的AI风暴,就是由这只胖乎乎的“龙虾”掀起的。