韩国再现“N号房”事件,大量Deepfake性犯罪引恐慌,超500所学校受影响

独家抢先看

编译 | 杨蕊伃

编辑 | 漠影

智东西9月4日消息,据BBC 9月3日报道,近期即时通讯软件Telegram出现了大量使用深度伪造技术的性犯罪事件,这些事件已经影响到了韩国500多所学校。目前,受影响的具体人数尚未确定。据悉,许多涉案的犯罪嫌疑人是青少年。

上周,韩国政界人士和警方承诺将对这些罪行进行彻底调查,并确保将肇事者绳之以法,以做出强有力的回应。

周一,韩国首尔国家警察厅宣布,将调查Telegram在允许分发非法使用深度伪造技术制作的儿童色情图片方面的责任。

据《环球时报》援引韩媒报道,针对女性的深度伪造犯罪在韩国日趋猖獗,不仅大学校园中出现此类案件,甚至连中小学、军队等场所也成为高发地。社交媒体上,特别是Telegram群组中不断有受害学校及被害者信息流出。

韩国男性频频使用AI技术,将熟人女性的照片换脸到现有的色情视频中,并在Telegram上进行传播和戏弄。

此前震惊世界的韩国“N号房”事件,正在频繁“更新”2.0乃至3.0版本。

一、用户利用Deepfake AI制造虚假露骨视频,女性肖像权受到侵犯

上周六,大学生Heejin(化名)收到了一个匿名Telegram消息,声称她的照片和个人信息被泄露。对方发送了一张她的照片和一张经过深度伪造技术处理的不雅图片,后者将她的脸非法合成在了一张具有性暗示的图片上。

在接受BBC采访时,Heejin表现的很自责:“我一直在想,是不是因为我把照片上传到了社交媒体,才导致了这样的事情。”

事实上,Heejin并不是唯一的受害者。

韩国记者Ko Narin在此前的调查中就在Telegram上发现了数十个聊天群组。

在这些群组中,用户分享他们认识的女性的照片,并使用AI软件在几秒钟内将这些照片转换成虚假的色情图片。

Ko告诉我们:“每时每刻都有人上传他们认识的女孩的照片,并要求将她们变成深度伪造的照片。”

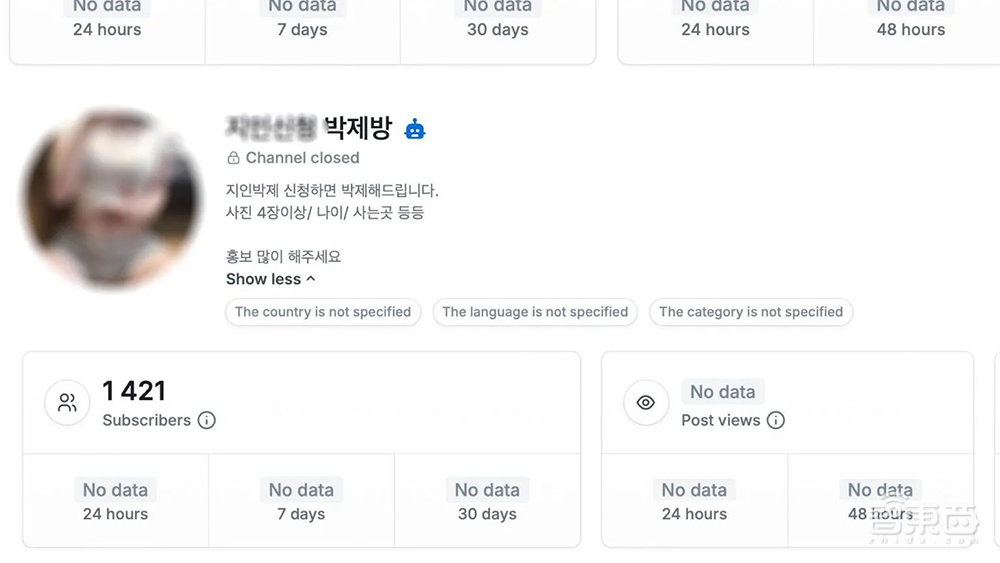

▲深度伪造聊天群组的说明,“如果你要求羞辱某人(进行深度伪造),我们会这样做。”(图源:BBC)

此外,Ko还发现,这些群组的目标不仅限于大学生,还包括特定高中甚至初中的学生。

如果很多内容是使用特定学生的图像创建的,该学生甚至可能拥有自己的“专属房间”。

这些房间通常被称为“羞辱室”,它们往往设有严格的进入条件。

Ko说:“我对这一过程的系统化和组织性感到震惊。”

她发现的最可怕的事情是,一所学校的未成年学生群组竟然拥有2000多名成员。

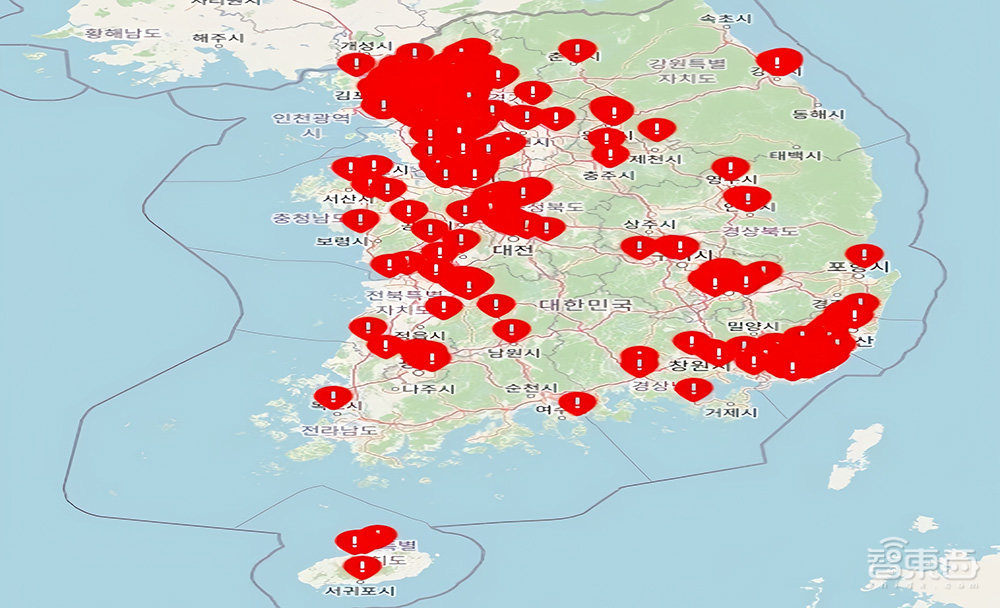

截至上周末,已经有500多所学校被确定受到影响。受影响的实际人数仍有待确定,但据悉许多人的年龄都在16岁以下。

▲截至1日,据信发生了深度伪造性犯罪的韩国学校(图源:《韩民族日报》)

二、深度伪造犯罪涉案人数约达22万,民众担心受害者规模继续扩大

Heejin事件后,韩国全国各地的许多女性出于对自己可能成为下一个被利用对象的恐惧,已经从社交媒体上删除了自己的照片或完全停用了账户。

早在此次事件之前,ACOSAV(韩国网络性虐待受害者维权中心)就已经注意到,深度伪造色情内容的未成年受害者人数急剧上升。

2023年,他们辅导了86名青少年受害者。而今年才到8月份,这一数字就跃升至238人。上周,在一周内就出现了64名青少年受害者。

对此,ACOSAV呼吁加强立法和公众教育,以保护未成年人免受此类AI技术的侵害。

据《韩民族日报》报道,截至目前,韩国全国涉及深度伪造犯罪的人数估计可能达到22万。这种情况导致许多女性感到不安和恐惧。

据悉,深度伪造技术的核心过程主要包括四个步骤:数据收集、模型训练、Deepfake合成和渲染。

创造深度伪造的核心是生成对抗网络(GAN),它由两个神经网络组成:生成器负责创建虚假图像或视频,而鉴别器则评估它们的真实性。

随着生成器和鉴别器的持续优化,深度伪造越来越难以被肉眼识别。

ACOSAV负责人Park Seonghye表示:“对我们来说,这是一场全面的紧急事件,其紧迫性堪比战争时期。随着最新深度伪造技术的出现,现在伪造的录像数量远远超过了以往,我们担心这种情况只会愈演愈烈。”

《福布斯》称,深度伪造技术常将真实人脸叠加在伪造或真实的色情材料上,导致许多年轻女性和女孩成为受害者,这已成为韩国公众极为愤怒的焦点话题。

▲Deepfake丑闻曝光后,韩国民众上街表示愤怒(图源:BBC)

大学生Ah-eun说:“我现在无法确定,是否会有人在我不知情的情况下对我做出不当行为。因此,我在与人交往时变得高度警惕,这并不是一个好现象。”

三、韩国将加大对深度伪造性犯罪的监管力度

韩国女权组织承认,新的AI技术使得剥削受害者变得更加容易。但他们认为,这不过是韩国网络上最新形式的厌女症的体现。

由84个妇女组织共同签署的一份声明中写道:“造成这一现象的根本原因是结构性性别歧视,而解决之道则是性别平等。”

这是对该国总统尹锡悦的直接批评,他否认结构性性别歧视的存在,削减了对受害者支持团体的资助,并正在废除政府的性别平等部。

此前,也有人批评韩国对深度伪造犯罪者的惩罚力度不足。

其中一个主要问题是,大多数犯罪者为青少年,他们在青少年法庭受审,而那里的判决通常较为宽松。

《韩民族日报》称,韩国性暴力救助中心主任认为,在学校、家庭等日常生活场所,非法拍摄、传播、合成、性侮辱等现象频繁发生,严重影响了女性的安全感。他强调:“现在是需要通过教育和平台监管等措施,加强组织合作来解决问题的时候了。”

与此同时,韩国政府表示将加强对创建和分享深度伪造图像行为的刑事处罚,并计划对那些观看非法色情内容的人实施惩罚。

结语:深度伪造图像日趋逼真,业界积极开发检测工具以提升识别能力

Deepfake技术在近年来得到了迅速发展,从最初的简单换脸到能够生成百万像素级别的深度伪造图像,技术的进步使得伪造图像和视频变得越来越逼真。

不止在韩国,深度伪造性犯罪在全球范围内都频繁发生。

用户利用深度伪造技术生成的图像绝大多数是针对年轻女性和未成年女孩,其内容涉及性侮辱、儿童性虐待等。

为了应对深度伪造技术带来的威胁,AI社区正在开发更高级的检测工具,以降低用户使用深度伪造技术犯罪的可能性。

这些检测工具运用机器学习算法分析视频和图像,以寻找伪造内容的迹象,包括不自然的面部动作、异常的光照模式,以及背景中的不一致性。

“特别声明:以上作品内容(包括在内的视频、图片或音频)为凤凰网旗下自媒体平台“大风号”用户上传并发布,本平台仅提供信息存储空间服务。

Notice: The content above (including the videos, pictures and audios if any) is uploaded and posted by the user of Dafeng Hao, which is a social media platform and merely provides information storage space services.”